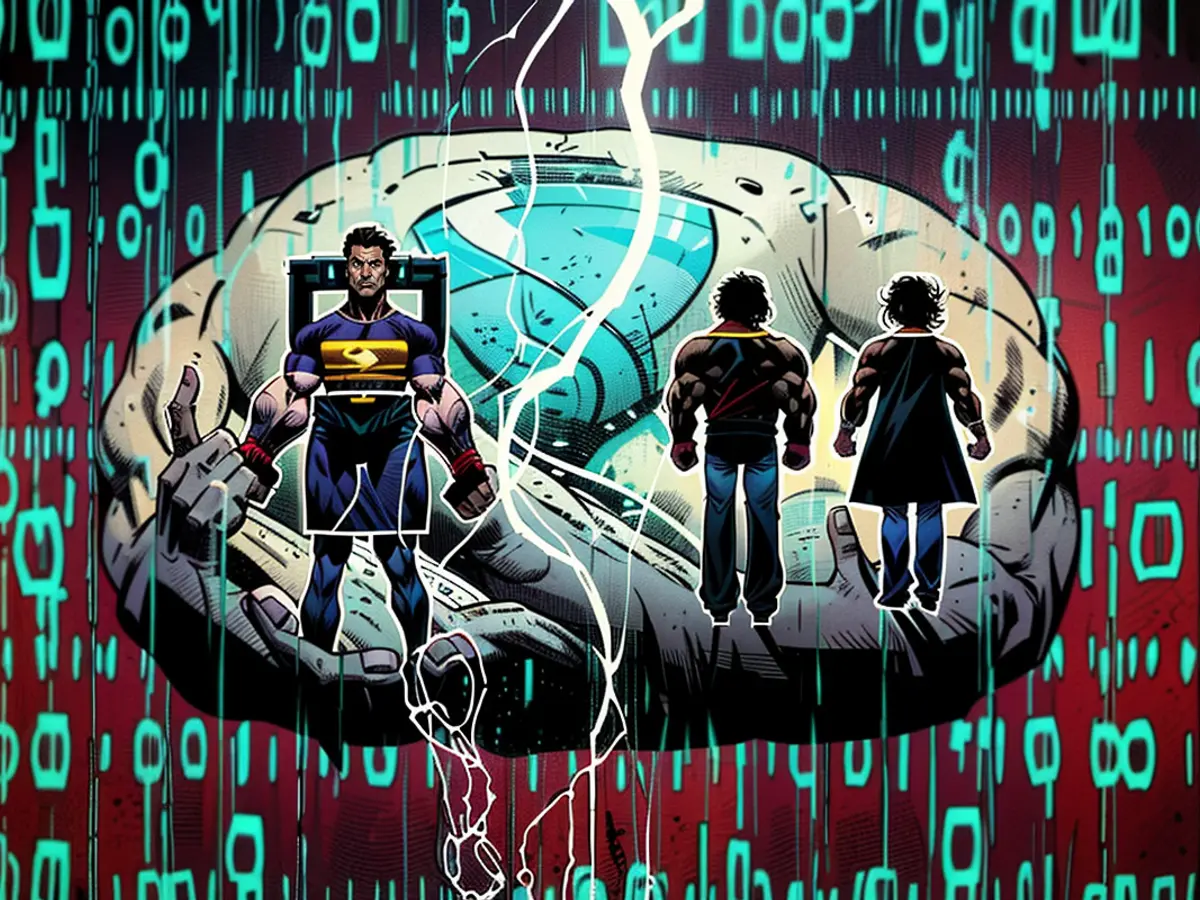

Las voces falsas provocan respuestas cerebrales

Vozes artificiales clonadas, creadas mediante tecnología deepfake, han causado una gran sensación, especialmente en intentos de fraude por teléfono. Estas voces generadas por AI engañan a las víctimas haciéndoles creer que están hablando con una persona real, y las últimas investigaciones revelan algunas sorprendentes descubrimientos sobre cómo funciona el cerebro frente a ellas.

Oro falso? Es difícil distinguir entre una voz humana real y una que ha sido sintetizada por AI, aunque puede ser inconsciente, el cerebro reacciona diferente a las voces deepfake en comparación a las naturales, según un equipo de investigadores publicado en la revista "Communications Biology". Escuchar una voz falsificada parece producir menos placer, informan.

Las algoritmos de sintetización de voz han llegado lo suficientemente lejos para que los marcadores de identidad de las voces clonadas artificiales sean muy similares a los de los hablantes reales. Estas voces falsificadas, fabricadas por tecnología deepfake, podrían potencialmente ser utilizadas en fraudes por teléfono o para disfrazar asistentes de voz como celebridades favoritas.

Un equipo de investigadores encabezado por Claudia Roswandowitz de la Universidad de Zurich evaluó cuán bien se preserva la identidad humana en las voces clonadas mediante el registro de cuatro hablantes alemanes en 2020 y la creación de voces falsas para cada hablante utilizando algoritmos informáticos.

Voces falsificadas son casi perfeccionamientos completos

Entonces, probaron la convincenteza de la imitación pidiéndole a 25 participantes si las identidades de dos voces presentadas eran idénticas o no. En aproximadamente dos tercios de las pruebas, las voces falsas fueron correctamente asignadas al respectivo hablante, lo que indica que actualmente las voces falsas no son engaños perfectos, pero tienen el potencial de engañar a las personas.

El equipo utilizó tomografía por resonancia magnética funcional (fMRT) para examinar cómo áreas individuales del cerebro reaccionan a voces falsas y reales. Descubrieron diferencias en dos áreas clave - el Núcleo Acumbens y el cortex auditivo. Ambas regiones, como explican, desempeñan un papel crucial en determinar si una persona reconoce una voz falsa como una falsedad o no.

"El Núcleo Acumbens es un elemento esencial del sistema de recompensas en el cerebro", explicó Roswandowitz. Fue menos activo cuando se comparó una voz falsa y una voz natural que cuando se comparaban dos voces reales. En otras palabras, escuchar una voz falsa activa el sistema de recompensas menos.

El cerebro intenta adaptarse

Hizo también una distinción en la análisis del cortex auditivo, responsable de analizar sonidos. La área fue más involucrada en reconocer la identidad de las voces falsas. "Suponemos que esta área reacciona a la imitación acústica de las voces falsas aún no perfecta y intenta compensar por el falta de señal acústica", dijo Roswandowitz.

La corteza compensó este desequilibrio en secreto. "Algo señala a la conciencia que algo es diferente y más difícil, pero esto a menudo queda por debajo del umbral de percepción".

Las tecnologías AI siguen avanzando

Además, los investigadores también investigaron cómo bien puede reconocer el cerebro las voces falsas. Encontraron que el cerebro reacciona diferente a las voces falsas que a las reales, especialmente en el cortex visual y el sistema límbico. El equipo especula que el cerebro intenta compensar por las inconsistencias en las voces falsas, pero esta compensación aún no es perfecta. Los investigadores especulan que la capacidad del cerebro para reconocer medios falsos de AI seguirá mejorando a medida que las tecnologías AI continúan avanzando.

Con el crecimiento rápido de las tecnologías de Inteligencia Artificial, la creación y distribución de falsedades han ido aumentando, según los investigadores del estudio. ¿Podrían las falsedades de hoy, que se crearon cuatro años atrás, completamente engañar a los oyentes? O serían los resultados similares? "Eso es una pregunta fascinante", dice Roswandowitz. Las voces generadas por AI nuevas probablemente tengan una calidad sonora un poco mejor, lo que podría llevar a diferencias menores de actividad en el cortex auditivo cuando se realizó el estudio. Sin embargo, ella espera resultados similares en el Núcleo Acumbens. "Sería muy interesante investigar experimentalmente esto".

Lea también:

- Las ofertas anticipadas del Black Friday de Walmart se han puesto hoy en marcha

- Escalada del conflicto: Putin insiste en que Kiev se retire de cuatro regiones y rechace el ingreso en la OTAN

- Eólica y solar: los costes de red se distribuirán de forma más equitativa

- Crisis presupuestaria: la CDU/CSU aumenta la presión sobre la coalición del semáforo